학습 목표: Playwright와 Python으로 동적 웹 크롤링 마스터하기

안녕하세요! ‘수석 IT 교육 강사’로서, 오늘 여러분과 함께 2026년 현재 가장 강력하고 효율적인 웹 크롤링 기술 중 하나인 Playwright와 Python을 활용하여 JavaScript 기반의 동적 웹페이지에서 데이터를 즉시 추출하는 실무 기술을 완벽하게 마스터할 것입니다.

기존의 정적 웹 크롤링 방식(예: BeautifulSoup, requests)은 JavaScript를 통해 동적으로 로드되는 콘텐츠를 처리하는 데 한계가 명확했습니다. 즉, 웹 브라우저처럼 JavaScript를 실행하여 페이지를 렌더링하지 못하기 때문에, “더보기” 버튼을 클릭하거나 스크롤 시 추가되는 콘텐츠, AJAX 요청으로 로드되는 데이터 등은 접근하기 어려웠죠. 하지만 Playwright는 실제 브라우저(Chromium, Firefox, WebKit)를 제어하여 이러한 동적인 상호작용을 완벽하게 시뮬레이션함으로써, 여러분이 원하는 모든 데이터를 손쉽게 크롤링할 수 있도록 돕습니다.

이 강의를 통해 여러분은 다음을 학습하게 됩니다:

- Playwright와 Python 환경 설정 및 필수 도구 설치

- JavaScript 동적 콘텐츠가 로드되는 웹페이지 분석 방법

- Playwright를 사용하여 브라우저를 제어하고 페이지를 탐색하는 기본 원리

- “더보기” 버튼 클릭, 스크롤, 특정 요소 대기 등 동적인 상호작용 처리

- 원하는 데이터를 정확하게 추출하고 구조화하는 기법

- 크롤링 과정에서 발생할 수 있는 예외 처리 및 고급 활용 팁

이제 이론은 잠시 접어두고, 바로 실습 환경을 구축하여 Playwright의 강력함을 직접 경험해 봅시다!

사전 준비 사항: 실습 환경 완벽 구축

성공적인 실습을 위해, 가장 먼저 여러분의 개발 환경을 최적으로 설정해야 합니다. 아래 권장 사항을 따라주시면, 강의 내용을 더욱 원활하게 소화하고 실습에 집중할 수 있습니다.

권장 개발 환경

- 통합 개발 환경 (IDE): Visual Studio Code (VS Code) 최신 버전. 확장 프로그램으로 Python Extension을 설치하시면 코드 작성 및 디버깅이 매우 편리합니다.

- 운영체제 (OS): Windows 10/11, macOS (최신 버전), 또는 Ubuntu 20.04+ 등 주요 운영체제 모두 지원합니다. Playwright는 크로스 플랫폼을 완벽하게 지원합니다.

- Python 버전: Python 3.9 이상. Playwright는

async/await구문을 적극적으로 활용하므로, 비동기 프로그래밍에 최적화된 최신 Python 버전 사용을 강력히 권장합니다.

필수 라이브러리 설치

Playwright를 사용하기 위해 필요한 Python 라이브러리와 브라우저 바이너리를 설치해야 합니다. 터미널 또는 명령 프롬프트에서 다음 명령어를 순서대로 실행해 주세요.

1. Playwright Python 라이브러리 설치

이 명령어는 Playwright를 Python 프로젝트에서 사용할 수 있도록 핵심 라이브러리를 설치합니다.

pip install playwright2. Playwright 브라우저 바이너리 설치

Playwright는 실제 브라우저 엔진(Chromium, Firefox, WebKit)을 제어하기 때문에, 해당 브라우저들의 바이너리 파일이 필요합니다. 이 명령어는 Playwright가 지원하는 모든 브라우저를 자동으로 다운로드하고 설정합니다.

playwright install설치가 완료되면, 여러분은 Playwright를 사용하여 웹페이지를 방문하고, JavaScript를 실행하며, 동적인 콘텐츠를 로드할 준비가 된 것입니다. 이제 본격적인 실습 과정으로 넘어가겠습니다.

단계별 실습 과정: 동적 웹페이지 데이터 크롤링 A to Z

이제 Playwright를 활용하여 동적 웹페이지의 데이터를 크롤링하는 구체적인 단계를 하나씩 밟아나가겠습니다. 각 단계마다 상세한 설명과 함께 실질적인 코드 예시를 제공하여 여러분의 이해를 돕겠습니다.

1단계: Playwright 설치 및 브라우저 준비

사전 준비 사항에서 이미 설치를 완료했지만, 다시 한번 그 의미를 짚어보겠습니다. pip install playwright는 Python 프로젝트에서 Playwright API를 사용할 수 있게 하며, playwright install은 Playwright가 제어할 실제 브라우저(Chromium, Firefox, WebKit)의 실행 파일을 설치합니다. 이 브라우저들은 여러분의 시스템에 독립적으로 설치되며, Playwright 스크립트가 실행될 때마다 이들을 제어하게 됩니다. 이 과정은 웹 크롤링에서 가장 중요한 ‘브라우저 렌더링 환경’을 구축하는 핵심 단계입니다.

2단계: 동적 웹페이지 분석 및 타겟 선정

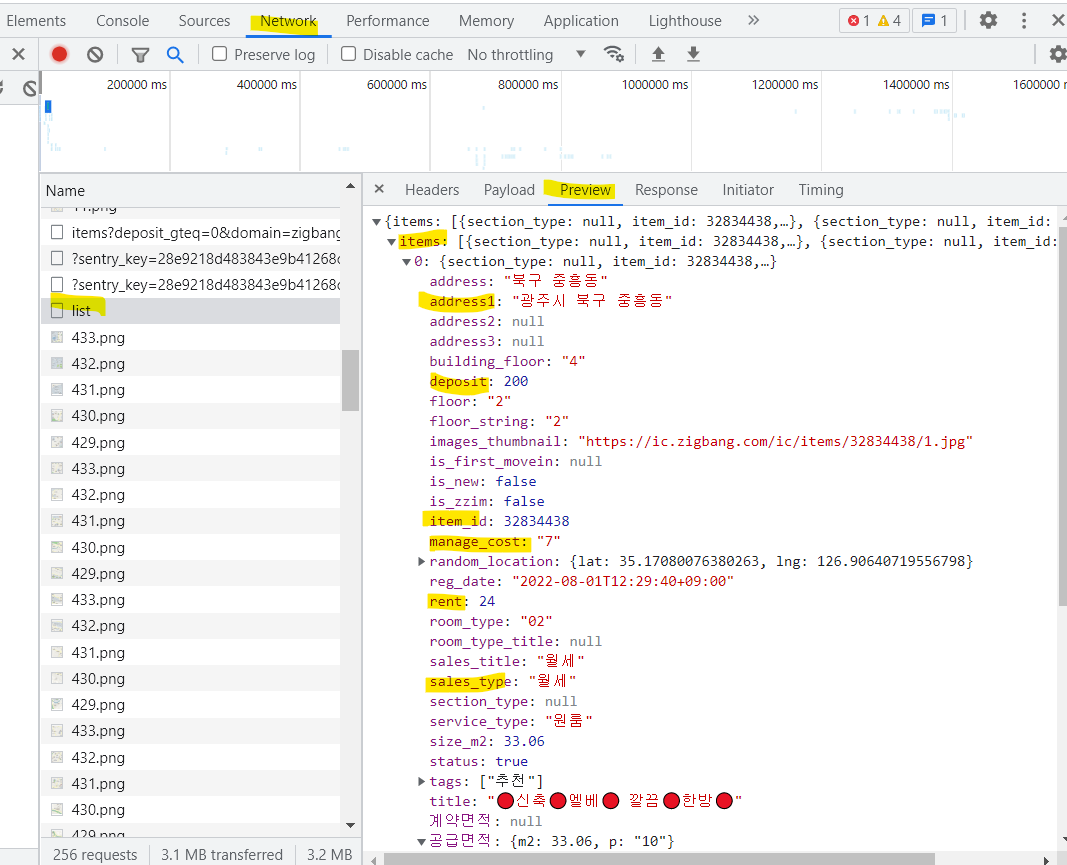

크롤링을 시작하기 전에, 우리가 데이터를 추출하고자 하는 웹페이지의 구조와 동적 특성을 이해하는 것이 중요합니다. 대부분의 동적 웹페이지는 JavaScript를 사용하여 콘텐츠를 로드하거나 업데이트합니다. 이를 파악하기 위해 웹 브라우저의 개발자 도구(Developer Tools)를 활용해야 합니다.

- 요소(Elements) 탭: 페이지의 HTML 구조를 확인하고, 원하는 데이터가 어떤 HTML 태그와 클래스, ID를 가지고 있는지 파악합니다.

- 네트워크(Network) 탭: 페이지 로드 시 또는 특정 상호작용(버튼 클릭, 스크롤) 시 발생하는 AJAX 요청들을 모니터링하여, 데이터가 어디서 어떻게 로드되는지 확인합니다.

이번 실습에서는 특정 가상의 동적 웹페이지를 가정하여 진행하겠습니다. 예를 들어, 무한 스크롤이나 “더보기” 버튼을 클릭해야 추가적인 상품 목록이 로드되는 쇼핑몰 페이지와 같은 시나리오를 상상해봅시다. 우리는 이 페이지에서 상품명과 가격 정보를 추출하는 것을 목표로 합니다. 이러한 동적 로딩 방식은 Playwright의 진가를 발휘하는 대표적인 사례입니다.

위 이미지는 일반적인 웹 크롤링 과정의 흐름을 보여줍니다. 특히 Playwright는 ‘Browser’와 ‘Page’ 객체를 통해 사용자가 웹을 탐색하는 것과 동일한 방식으로 데이터를 수집할 수 있게 합니다.

3단계: Playwright 스크립트 기본 구조 이해

Playwright는 비동기(async/await) 방식으로 작동합니다. 이는 웹페이지 로딩, 요소 상호작용 등 시간이 오래 걸리는 작업을 효율적으로 처리하기 위함입니다. 기본적인 스크립트 구조는 다음과 같습니다.

import asyncio

from playwright.async_api import async_playwright

async def main():

async with async_playwright() as p:

# 1. 브라우저 실행 (headless=True는 브라우저 UI를 숨김, 개발 시에는 False로 설정하여 시각적으로 확인하는 것이 좋음)

browser = await p.chromium.launch(headless=True)

# browser = await p.firefox.launch(headless=False) # Firefox 또는 WebKit 사용 가능

# browser = await p.webkit.launch(headless=False)

# 2. 새로운 페이지(탭) 열기

page = await browser.new_page()

# 3. 목표 URL로 이동

target_url = "https://www.example.com/dynamic-products" # 실제 동적 웹페이지 URL로 대체하세요.

print(f"'{target_url}' 페이지로 이동 중...")

await page.goto(target_url, wait_until="domcontentloaded") # 'domcontentloaded'는 DOM이 로드될 때까지 기다림

print("페이지 로드 완료.")

# 4. (이후 단계에서 동적 콘텐츠 처리 및 데이터 추출 코드 추가)

# 5. 브라우저 닫기

await browser.close()

print("브라우저 종료.")

if __name__ == "__main__":

asyncio.run(main())

이 코드는 Playwright를 사용하여 Chromium 브라우저를 실행하고, 지정된 URL로 이동한 다음 브라우저를 닫는 가장 기본적인 흐름을 보여줍니다. headless=False로 설정하면 브라우저가 실제로 열리고 페이지가 로드되는 과정을 눈으로 확인할 수 있어 디버깅에 매우 유용합니다.

4단계: JavaScript 동적 콘텐츠 대기 및 상호작용

Playwright의 핵심 강점은 JavaScript에 의해 동적으로 로드되는 콘텐츠를 기다리고 상호작용할 수 있다는 점입니다. 예를 들어, 페이지가 로드된 후 특정 상품 목록이 AJAX 요청을 통해 뒤늦게 나타나거나, “더보기” 버튼을 클릭해야 다음 페이지의 콘텐츠가 로드되는 경우를 처리할 수 있습니다.

우리는 page.wait_for_selector(), page.wait_for_load_state(), page.click() 등의 메서드를 활용하여 이러한 동적 요소를 제어합니다.

import asyncio

from playwright.async_api import async_playwright

async def main():

async with async_playwright() as p:

browser = await p.chromium.launch(headless=False) # 디버깅을 위해 headless=False 설정

page = await browser.new_page()

# 가상의 동적 웹페이지 URL (실제 테스트 시에는 여러분이 분석한 페이지로 변경)

# 이 예시에서는 Playwright가 제공하는 간단한 동적 페이지를 활용하거나,

# 여러분이 직접 만든 로컬 HTML 파일을 사용할 수 있습니다.

# 예: 버튼 클릭 시 목록이 추가되는 페이지

target_url = "https://playwright.dev/python/docs/api/class-page#page-wait-for-selector" # Playwright 공식 문서 페이지를 예시로 사용

await page.goto(target_url, wait_until="domcontentloaded")

print(f"'{target_url}' 페이지 로드 완료. 동적 요소 대기 중...")

# 예시 1: 특정 요소가 나타날 때까지 기다리기 (CSS Selector 사용)

# Playwright 문서 페이지의 특정 섹션 제목을 기다린다고 가정

try:

# 'main' 태그 내의 'h1' 태그를 기다림 (실제로 페이지 로드 시 바로 나타남)

await page.wait_for_selector("main h1", state='visible', timeout=10000)

print("섹션 제목 요소가 나타났습니다.")

except Exception as e:

print(f"요소 대기 실패: {e}")

# 예시 2: "더보기" 버튼 클릭 시나리오 (가상)

# 실제 웹페이지에서 '더보기' 버튼의 CSS 셀렉터를 찾아야 합니다.

# 여기서는 가상의 버튼을 가정합니다.

# await page.click("button.load-more-button") # 실제 웹페이지의 버튼 셀렉터로 변경

# print("더보기 버튼 클릭 완료.")

# 버튼 클릭 후 새로운 콘텐츠가 로드될 때까지 대기

# await page.wait_for_selector(".new-product-item", state='visible', timeout=10000)

# print("새로운 상품 목록이 로드되었습니다.")

# 페이지 스크롤 다운 (무한 스크롤 페이지의 경우)

# await page.evaluate("window.scrollTo(0, document.body.scrollHeight)")

# await page.wait_for_timeout(2000) # 스크롤 후 콘텐츠 로드 대기 (필요 시)

print("동적 상호작용 단계 완료.")

await browser.close()

if __name__ == "__main__":

asyncio.run(main())

위 코드에서 page.wait_for_selector()는 지정된 CSS 셀렉터에 해당하는 요소가 DOM에 나타나고 ‘visible’ 상태가 될 때까지 기다립니다. 이는 AJAX 요청 등으로 뒤늦게 로드되는 콘텐츠를 처리할 때 필수적입니다. 또한 page.click()을 사용하여 버튼을 클릭하거나, page.evaluate()를 통해 직접 JavaScript 코드를 실행하여 스크롤하는 등의 복잡한 상호작용도 가능합니다.

5단계: 데이터 추출 및 처리

동적으로 로드된 페이지에서 원하는 요소가 모두 나타났다면, 이제 해당 요소들로부터 데이터를 추출할 차례입니다. Playwright는 강력한 로케이터(Locators) API를 제공하여 CSS 셀렉터나 XPath를 이용해 요소를 쉽게 찾고, 그 안의 텍스트나 속성 값을 추출할 수 있습니다.

import asyncio

from playwright.async_api import async_playwright

async def main():

async with async_playwright() as p:

browser = await p.chromium.launch(headless=True) # 추출 시에는 headless=True로 효율성 높이기

page = await browser.new_page()

# 실습을 위한 가상 URL (실제 동적 페이지로 대체)

# 여기서는 간단한 HTML 구조를 가정합니다.

# 예를 들어, <div class="product-item"><h3 class="product-name">상품명</h3><span class="product-price">가격</span></div>

# 와 같은 구조의 상품 목록 페이지를 가정합니다.

target_url = "https://quotes.toscrape.com/js/" # JavaScript 동적 로딩 예시 페이지

await page.goto(target_url, wait_until="domcontentloaded")

print(f"'{target_url}' 페이지 로드 완료. 데이터 추출 시작...")

scraped_data = []

# "Next" 버튼을 클릭하여 모든 페이지를 순회하는 로직

while True:

# 인용구 목록이 로드될 때까지 대기

await page.wait_for_selector("div.quote", state='visible', timeout=10000)

# 모든 인용구 요소 가져오기

quotes = await page.locator("div.quote").all()

for quote in quotes:

text = await quote.locator("span.text").text_content()

author = await quote.locator("small.author").text_content()

tags_elements = await quote.locator("div.tags a.tag").all()

tags = [await tag.text_content() for tag in tags_elements]

scraped_data.append({

"text": text.strip(),

"author": author.strip(),

"tags": tags

})

# 다음 페이지 버튼 확인 및 클릭

next_button = page.locator("li.next a")

if await next_button.is_visible():

await next_button.click()

await page.wait_for_load_state('networkidle') # 다음 페이지 로드 대기

print("다음 페이지로 이동...")

else:

print("마지막 페이지입니다. 크롤링 종료.")

break

print("\n--- 추출된 데이터 ---")

for item in scraped_data:

print(item)

print(f"\n총 {len(scraped_data)}개의 인용구를 추출했습니다.")

await browser.close()

if __name__ == "__main__":

asyncio.run(main())

위 이미지는 Playwright가 브라우저를 구동하고 웹페이지에서 데이터를 추출하는 전반적인 과정을 시각적으로 보여줍니다. page.locator("CSS_SELECTOR").all()는 지정된 셀렉터에 해당하는 모든 요소를 리스트로 반환하며, 각 요소에 대해 .text_content(), .inner_text(), .get_attribute('속성명') 등을 사용하여 원하는 데이터를 추출할 수 있습니다. 추출된 데이터는 파이썬 리스트나 딕셔너리 형태로 저장하여 후처리하기 용이하게 만듭니다.

6단계: 예외 처리 및 고급 크롤링 기법

실제 웹 크롤링 환경에서는 네트워크 문제, 타임아웃, 예기치 않은 웹페이지 구조 변경 등 다양한 예외 상황이 발생할 수 있습니다. 안정적인 크롤러를 만들기 위해서는 이러한 예외를 적절히 처리하고, 필요에 따라 고급 기법을 적용해야 합니다.

- 타임아웃 설정:

page.goto(),page.wait_for_selector()등 대부분의 Playwright 메서드에는timeout인수가 있습니다. 이를 적절히 설정하여 무한 대기를 방지합니다. try-except블록: 네트워크 오류, 요소 찾기 실패 등 예측 가능한 예외를try-except블록으로 감싸서 프로그램이 비정상적으로 종료되지 않도록 합니다.- 헤드리스 모드 (

headless=True): 실제 브라우저 UI 없이 백그라운드에서 실행되어 리소스 사용량을 줄이고 속도를 향상시킵니다. 개발 및 디버깅 시에는headless=False로 설정하여 시각적으로 확인하는 것이 좋습니다. - 사용자 에이전트 (User-Agent) 변경: 웹사이트가 봇 접근을 차단하는 경우,

page.set_extra_http_headers({"User-Agent": "Mozilla/5.0..."})와 같이 User-Agent를 변경하여 일반 사용자로 위장할 수 있습니다. - 스크린샷 찍기: 디버깅 목적으로 특정 시점의 페이지 화면을 캡처할 수 있습니다.

await page.screenshot(path="screenshot.png") - 프록시 사용: IP 차단을 우회하거나 지리적 제한을 극복하기 위해 프록시 서버를 사용할 수 있습니다.

browser = await p.chromium.launch(proxy={"server": "http://ip:port"})

이러한 고급 기법들을 적재적소에 활용하면 더욱 견고하고 효율적인 Playwright 크롤러를 구축할 수 있습니다.

결과 확인: 추출된 데이터 검증 및 활용

데이터 추출 스크립트를 성공적으로 실행했다면, 이제 추출된 데이터가 우리가 의도한 대로 잘 수집되었는지 확인하는 단계입니다. 앞선 예시 코드에서는 추출된 데이터를 단순히 콘솔에 출력했지만, 실제 프로젝트에서는 이 데이터를 더욱 유용하게 활용해야 합니다.

위 이미지는 Playwright를 활용한 성공적인 크롤링의 결과물, 즉 깔끔하게 정돈된 데이터의 모습을 상상하게 합니다. 데이터 검증은 추출된 데이터의 양, 형식, 내용의 정확성을 확인하는 과정입니다. 예를 들어, 모든 상품명이 올바르게 추출되었는지, 가격 정보가 숫자로 잘 파싱되었는지 등을 육안으로 또는 간단한 스크립트로 검증할 수 있습니다.

데이터 활용 방안

- CSV/JSON 파일로 저장: 가장 일반적인 방법입니다. pandas 라이브러리를 활용하면 데이터를 DataFrame으로 쉽게 변환하여 CSV나 JSON 파일로 저장할 수 있습니다.

import pandas as pd # scraped_data는 위에서 추출한 데이터 리스트라고 가정 df = pd.DataFrame(scraped_data) df.to_csv("quotes.csv", index=False, encoding="utf-8-sig") df.to_json("quotes.json", orient="records", indent=4, ensure_ascii=False) print("데이터가 'quotes.csv' 및 'quotes.json'으로 저장되었습니다.") - 데이터베이스에 저장: MySQL, PostgreSQL, MongoDB 등 데이터베이스에 직접 저장하여 영구 보관하고 다른 애플리케이션에서 활용할 수 있습니다. SQLAlchemy나 pymongo 같은 라이브러리를 사용합니다.

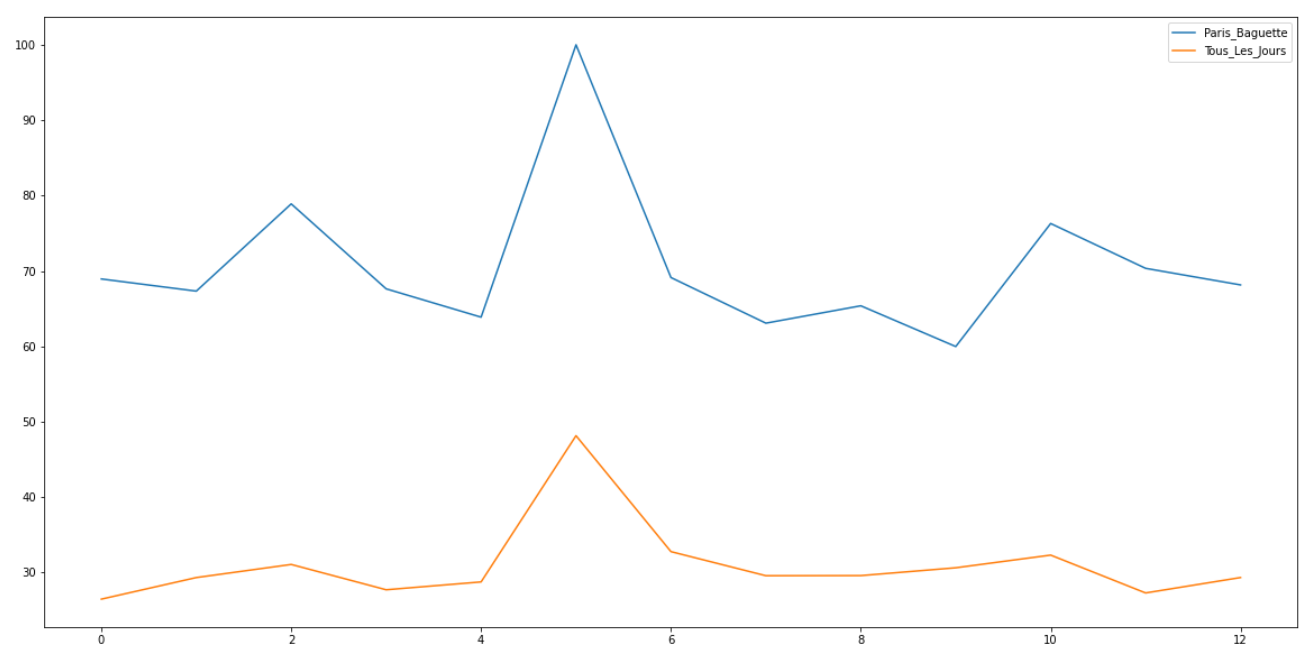

- 데이터 분석 및 시각화: 추출된 데이터를 바탕으로 시장 동향 분석, 경쟁사 가격 비교, 사용자 리뷰 분석 등 다양한 데이터 분석 및 시각화 프로젝트를 진행할 수 있습니다.

크롤링의 최종 목표는 단순한 데이터 수집을 넘어, 수집된 데이터를 통해 유의미한 가치를 창출하는 것입니다. Playwright를 통해 얻은 데이터를 적극적으로 활용하여 여러분의 프로젝트에 생명을 불어넣으세요.

마무리: Playwright와 함께하는 미래 지향적 웹 크롤링

오늘 우리는 Playwright와 Python을 사용하여 JavaScript 동적 웹페이지에서 데이터를 즉시 크롤링하는 강력한 실무 기술을 학습했습니다. 2026년 현재, 웹은 점점 더 동적으로 변화하고 있으며, 전통적인 크롤링 방식으로는 접근하기 어려운 정보들이 많아지고 있습니다.

Playwright는 이러한 현대 웹 환경에 완벽하게 대응할 수 있는 최적의 도구입니다. 실제 브라우저를 제어함으로써, 사용자가 웹사이트를 이용하는 것과 동일한 방식으로 모든 동적 콘텐츠를 렌더링하고 상호작용할 수 있기 때문입니다. 여러분은 이제 “더보기” 버튼, 무한 스크롤, AJAX 로드 등 어떤 복잡한 시나리오 앞에서도 당황하지 않고 필요한 데이터를 정확하게 추출할 수 있는 역량을 갖추게 되었습니다.

이 강의는 Playwright를 활용한 동적 웹 크롤링의 시작점입니다. 오늘 배운 내용을 바탕으로 다양한 웹사이트에 적용해보고, Playwright의 더 많은 기능(예: 인증 처리, 파일 다운로드, 페이지 간 이동 등)을 탐색하며 여러분의 크롤링 기술을 더욱 발전시키시길 바랍니다. 끊임없이 배우고 도전하는 IT 전문가로서, Playwright는 여러분의 강력한 동반자가 될 것입니다.

궁금한 점이 있다면 언제든지 질문하고, 함께 성장해 나갑시다. 여러분의 성공적인 IT 커리어를 응원합니다!